Sunda Pichai in Lex Fridman Podcast.

p(doom)

En una extrevista en el podcast de Lex Friedman, Sunda Pichai, CEO de Google, comenta el posible escenario del que se habla sobre la IA, escenario etiquetado como p(doom). Ambos son masones, y en la secta creen que la sangre no les salpicará y que disfrutarán de un después, de ese Orden luciferino tras el Great Reset. Ingenua Babilonia.

p(doom) es una probabilidad estimada de que una IA superinteligente destruya la civilización humana.

- Artificial General Intelligence (AGI).

- Super Artificial Intelligence (ASI).

Lex Fridman Podcast (09 jun 2025)

Sundar Pichai’s p(doom): Will AI destroy human civilization?

Lex Fridman: «Quizás una pregunta más de cocina. Este un concepto aún más ridículo. Es el de p(doom). Así que, los de mentalidad filosófica, la gente de la comunidad de IA piensa en la probabilidad de que la AGI y luego la ASI podrían destruir toda la civilización humana. Diría que mi pronóstico de p(doom) es de aproximadamente un 10%. ¿Alguna vez piensas en este tipo de amenaza a largo plazo de ASI, y cuál sería el desastre para Europa?

Sundar Pichai: «Mira, quiero decir, seguro. Mira, estoy muy entusiasmado con la IA. Pero siempre he sentido que esta es una tecnología, ya sabes, que tenemos que pensar activamente en los riesgos y trabajar muy duro para aprovecharla de manera que todo funcione. Sobre la pregunta de p(doom), mira, no te sorprenderá decir que probablemente sea otra conversación de micrococina que surge de vez en cuando, ¿verdad? Y dado lo poderosa que es la tecnología. Tal vez, dando un paso atrás, ya sabes, cuando estás dirigiendo una organización grande, si puedes lograr que toda la gente marche hacia meta de una manera muy enfocada, con una misión en mente, puedes lograr prácticamente cualquier cosa, ¿verdad? Ya sabes, si puedes conseguir que la gente marche hacia una meta de una manera muy enfocada, con una misión, puedes lograr prácticamente cualquier cosa. Pero es muy difícil organizar a toda la humanidad de esa manera. Pero creo que si el p(doom) llega a un nivel alto en algún momento, toda la humanidad está alineada para asegurarse ese no es el caso. ¿Verdad? Y de hecho haremos más avances al respecto. Creo que sí. La ironía es que hay un aspecto automodulador ahí, creo que si la humanidad colectivamente se propone resolver un problema, cualquiera que sea, creo que podemos lograrlo. Así que debido a eso, ya sabes, creo que soy optimista sobre los escenarios p(doom), Pero eso no significa que… Creo que el riesgo subyacente es bastante alto. Pero, soy, ya sabes, tengo mucha fe en que la humanidad esté a la altura en ese momento.»

Lex Fridman: «Eso está muy bien dicho. Quiero decir, a medida que la amenaza se vuelve más concreta y real, los humanos realmente se unen y ponen sus cosas en orden. Bueno, la otra cosa de la que creo que la gente no suele hablar es la probabilidad de destrucción sin IA. Entonces, existen todas estas otras maneras en las que los humanos pueden autodestruirse a sí mismos. Y es muy posible, al menos eso creo, que la IA nos ayude a ser más inteligentes, más amables entre nosotros, más eficientes. Eso ayudará a que más partes del mundo prosperen en un lugar con menos recursos limitados, que a menudo la fuente de conflictos militares y tensiones, etc. Así que también tenemos para cargar con eso. ¿Cuál es el p(doom) sin IA, con IA? P(doom) con IA y P(doom) sin IA. Porque es muy posible que la IA sea lo que nos salve, lo que salve a las civilizaciones humanas de todas las demás amenazas?

Sundar Pichai: «Estoy de acuerdo contigo. Creo que es esclarecedor. Mira, pensé que para avanzar en algunos de los problemas más difíciles, sería bueno tener una IA como una pareja ayudándote, ¿verdad? Y como sabes, así que eso resuena en mí con seguridad. Sí.»

La conversación está recogida en la prensa digital: infobae.com; elespanol.com; cronista.com; etc.

Enlaces Relacionados

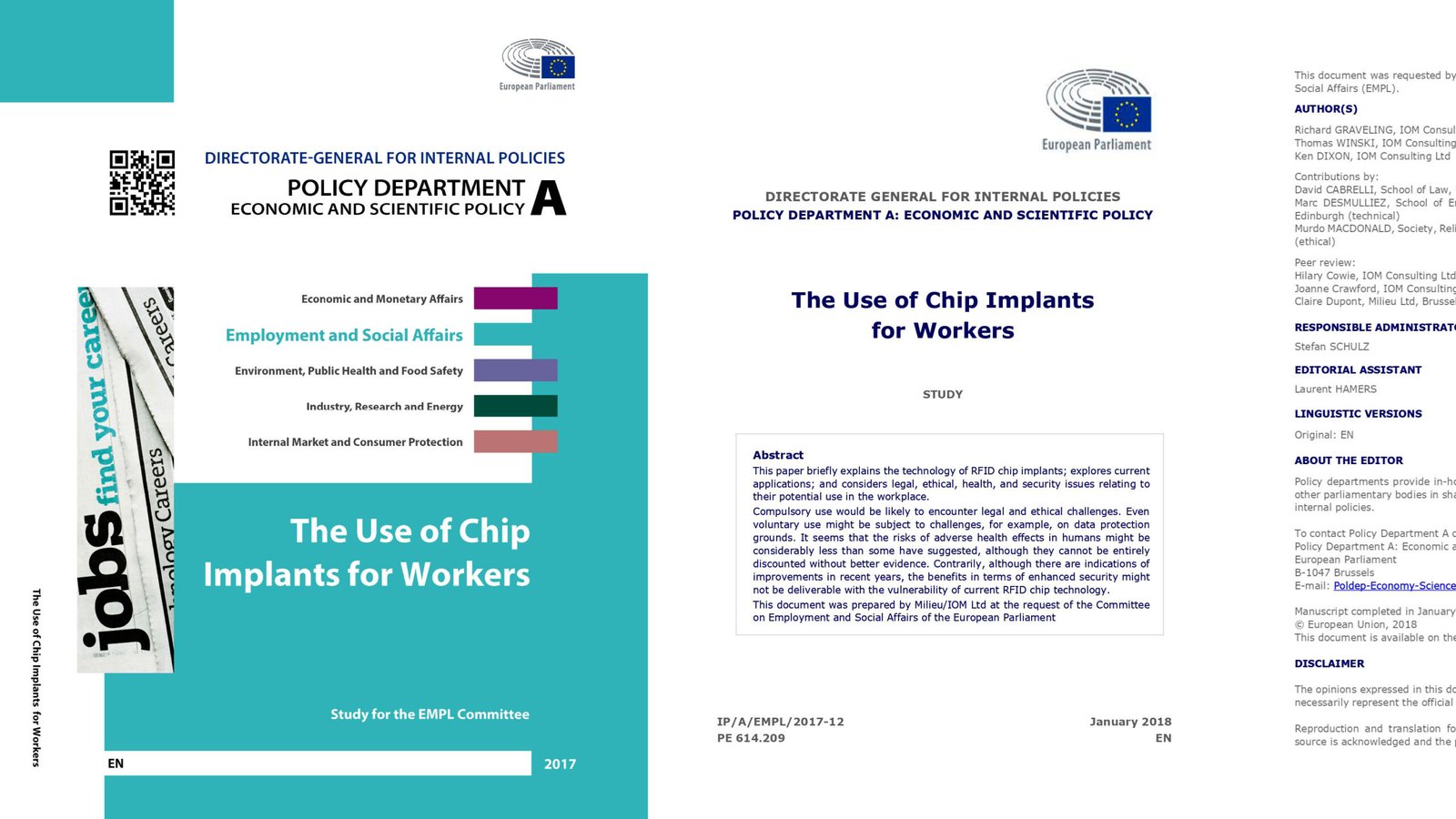

Algunos ejemplos de esta gente de la masonería, de sus temas de conversación, la gente tras la Agenda2030 y tras ese distópico y luciferino «Nuevo» Orden Mundial.